წარმოიდგინეთ 1890-იანი წლების ლონდონი - ბრიტანული იმპერიის საზღვაო, ეკონომიკური და ინსტიტუციური ძალის წყალობით იმდროინდელი მსოფლიოს დედაქალაქი.

ეს იყო ინდუსტრიული რევოლუციისა და ინფრასტრუქტურული გარდაქმნის ავანგარდში მყოფი მეტროპოლისი, სადაც ქვანახშირითა და ორთქლით გამომუშავებული ენერგია მანამდე არნახულ მასშტაბებს აღწევდა, რაც, თავის მხრივ, ურბანულ, სანაოსნო და სარკინიგზო სისტემებს ასაზრდოებდა.

ასეთ მღელვარე ეპოქაში ჩნდება გადაადგილების ახალი საშუალება - ავტომობილი - რომელიც საწყის ეტაპზე არის მოუხერხებელი, არაპრაქტიკული და მცირე მასშტაბის წარმოების მქონე.

მაშინდელი გადმოსახედიდან თითქმის სრულად დაუჯერებელი იქნებოდა იმის თქმა ან წარმოდგენა, რომ სულ რაღაც ორ ათწლეულში ეს გამოგონება ყოვლისმომცველად დაიწყებდა ცხენებსა და ეტლებზე დამყარებული სატრანსპორტო სისტემის ჩანაცვლებას არა მხოლოდ ლონდონში, არამედ ერთდროულად მსოფლიოს წამყვან ქალაქებში.

1890-იანი წლების მიწურულს ნიუ-იორკში ყოველდღიურად დაახლოებით 200 000-მდე ცხენი გამოიყენებოდა ტრანსპორტირებისთვის. გადაადგილების ეს მეთოდი კი თავისთავად მოიცავდა ათასობით სამუშაო ადგილს; მის გარშემო ხდებოდა ქალაქების დაგეგმარება და მშენებლობა; ამ სისტემაზე იყო მიბმული არაერთი ინდუსტრიაც - თავლებიდან დაწყებული, სამჭედლოებით დამთავრებული.

თუმცა, ავტომობილის გამოგონებამ დაახლოებით 20 წელიწადში ისტორიის თაროზე შემოდო გადაადგილების უძველესი საშუალება, რომელიც სათავეს იღებდა იმ დღიდან, როცა მრავალი ათასწლეულის წინ ჩვენმა წინაპარმა მოშინაურებულ ოთხფეხა პირუტყვს პირველად შეაბა ხის იარაღი. ამ პროცესმა თან გაიყოლა ყველა ის სამუშაო ადგილი და ინდუსტრია, რომელსაც ცხენებითა და ეტლებით გადაადგილების სისტემა ემყარებოდა.

უკეთ წარმოსადგენად, თუ ნიუ-იორკში 1880 წელს იყავი დაბადებული, ოცი წლის ასაკამდე გაიზრდებოდი ქალაქში, რომლის ყოველდღიური რიტმის განმსაზღვრელი ცხენი და ეტლი იყო. 35 წლის ასაკში კი იმ ქუჩებში, სადაც ბავშვობა გქონდა გატარებული, უკვე მანქანებით მოძრაობა იქნებოდა გაბატონებული და მოგიწევდა იმის გათავისება, რომ ცხენების როლი ურბანულ ცხოვრებაში შეუქცევადად მილევადი იყო. ხოლო 50-იანებში შენი შვილებისთვის ან შვილთაშვილებისთვის ეტლით გადაადგილება მხოლოდ განსაკუთრებული შემთხვევა ან მათთვის ნოსტალგიით მოყოლილი ამბავი იქნებოდა.

ეს ჩანაცვლება არ იყო უეცარი, თუმცა მას თან ახლდა გარდაუვალობისა და უძლურობის განცდა. გარდაქმნა მოხდა ეტაპობრივად, მაგრამ ადამიანის ცხოვრებისეული გამოცდილების გადმოსახედიდან, ცვლილება ნამდვილად ფორსმაჟორული იყო:

ასეულობით წლის განმავლობაში ჩამოყალიბებული მთლიანი ცხოვრების წესი, თავისი ინფრასტრუქტურითა და ეკოსისტემით, ადამიანის სიცოცხლის ნახევარზე ნაკლებ პერიოდში გაქრა.

დღესდღეობით უკვე დამკვიდრებულია წარმოდგენა, რომ კაცობრიობა მორიგი გარდამტეხი მომენტის წინაშე დგას და ამ განცდის საფუძველი ძირითადად ხელოვნური ინტელექტის (AI) განხრით მომხდარი ტექნოლოგიური განვითარება, მიღწეული წარმატება და ზოგადად ცვლილებათა სისწრაფეა.

ამ განცდას ამძაფრებს ისიც, რომ წინა საუკუნეებისგან განსხვავებით მიმდინარე პროცესის აღქმა, სხვადასხვა მიზეზებით, ბევრად უფრო გათავისებული და თვალშისაცემია.

ტექნოლოგიური სექტორისთვის ცხადია, რომ ვცხოვრობთ მეოთხე ინდუსტრიული რევოლუციის პერიოდში, რასაც უფრო ხშირად "AI ეპოქას" ან "AI რევოლუციას" უწოდებენ - ესეც, თავის მხრივ, ისევ მოლოდინების უპრეცედენტობაზე მეტყველებს.

შესაბამისად, ბოლო 2-3 წელიწადში AI ტექნოლოგიის ჯერარნახულმა განვითარებამ გაგვიჩინა ისტორიულ გამოცდილებაზე დამყარებული წარმოდგენა, რომ წინ დიდი, შესაძლოა, აქამდე გაუგონარი მასშტაბების ცვლილებების წლები გველოდება.

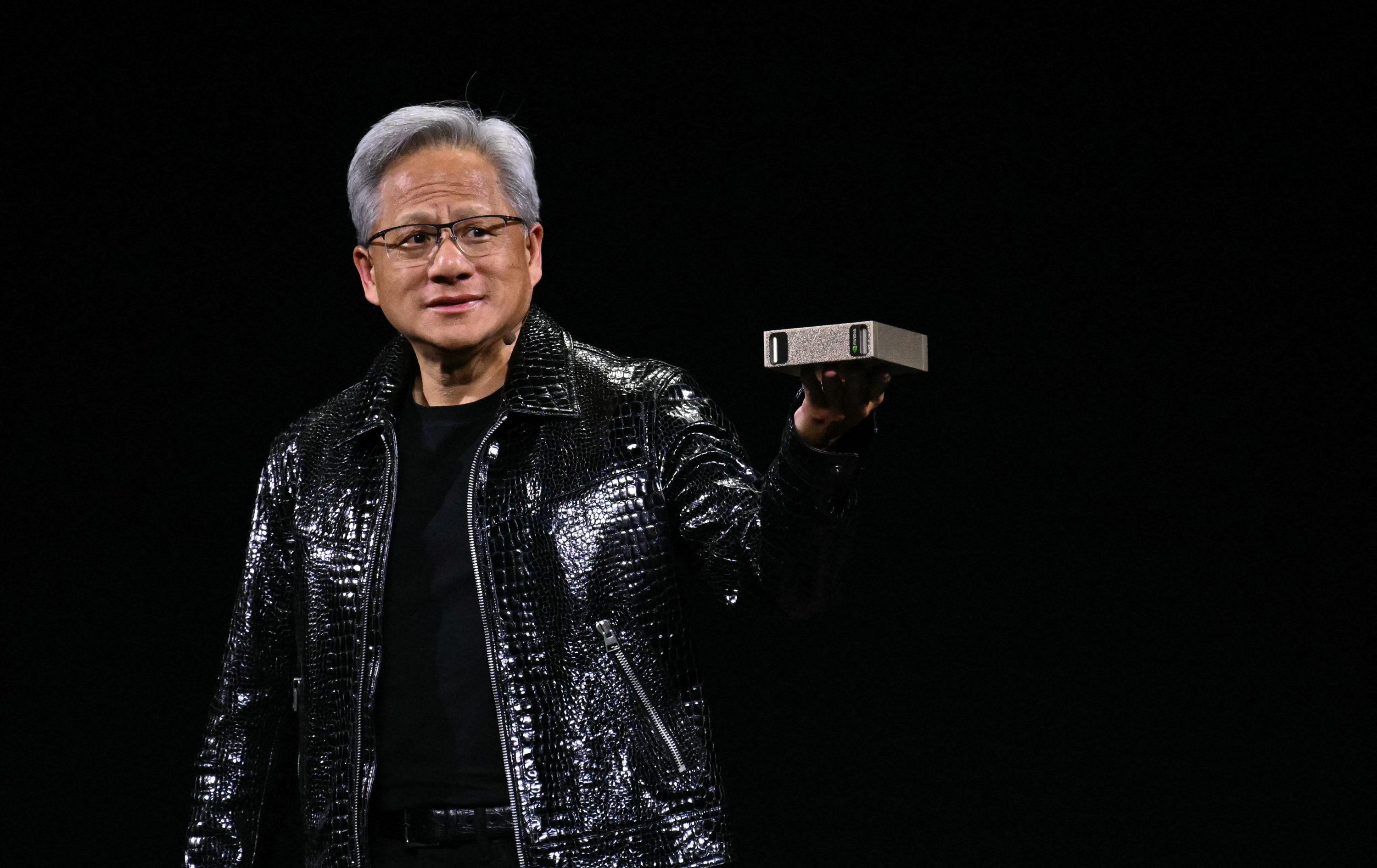

ამ განწყობის შექმნას დიდწილად თავად "AI-ს არქიტექტორებმაც" შეუწყვეს ხელი, რომლებიც, ერთად აღებული, გამოცემა TIME-მა 2025 წლის ადამიანებად დაასახელა. Nvidia-ს აღმასრულებელი დირექტორი ჯენსენ ჰუანგი, OpenAI-ს სემ ალტმანი, Meta-ს მარკ ზაკერბერგი, xAI-ს ილონ მასკი და სხვები არიან ის პირები, რომელთა ძალისხმევითაც 2025 წელს განსაკუთრებული სისწრაფით გაფართოვდა ხელოვნური ინტელექტის მიმართულება და მისი სოციალური გავლენა.

ამ ტექნოლოგიური რბოლის ლიდერები გლობალური მასშტაბის ძალზე კონკურენტულ გარემოში გრეიჰაუნდებივით "მექანიკური სატყუარის" დაჭერას თავდაუზოგავი მონდომებით ცდილობენ და ბუნდოვანი მწვერვალისკენ მიექანებიან. პარალელურად, ისინი ძალაუნებურად ქმნიან საფუძველს კაცობრიობის განვითარების მიმართულების პარადიგმული გარდაქმნისთვის, რასაც 2025 წელს უკვე ხელშესახები გავლენა ჰქონდა ყველა ჩვენგანის ყოველდღიურ გამოცდილებაზე, სამუშაოსა თუ განათლებაზე.

საკმარისია შევხედოთ 2025 წელს მოწინავე AI კომპანიების მიერ დიდი ენის მოდელების (LLM) კუთხით განვლილ პროგრესს, რაც დროის დინებასთან ერთად მზარდად შთამბეჭდავი იყო.

განმარტებისთვის, დიდი ენის მოდელი (LLM) არის AI სისტემა, რომელიც დიდი ოდენობის ტექსტებზეა გაწვრთნილი, რითაც მას შეუძლია, ენაში არსებული პატერნების შესწავლა. თუმცა, მომხმარებლისგან კითხვის დასმის ან დიალოგის დაწყების შემდეგ, LLM-ები ტექსტის გენერირებას უშუალოდ გაწვრთნილ მონაცემებში პასუხის ძებნის ნაცვლად, დასწავლილ ალბათობებსა და პატერნებზე დაყრდნობით, მომდევნო სიტყვის პროგნოზირებით ცდილობენ. უფრო მარტივად რომ ვთქვათ, მოდელი არ ეძებს ტექსტში პასუხს, არამედ საპასუხო ტექსტს ქმნის იმის მიხედვით, თუ რომელ სიტყვას აქვს ყველაზე მეტი ალბათობა, რომ წინა სიტყვას მოსდევდეს.

AI პროგრესი 2025 წელს

წელს კონკურენტუნარიან გარემო-პირობებში ჰორიზონტზე გამოჩნდა LLM-ებს შორის ლიდერობის არაერთი ძლიერი კანდიდატი, რომლებიც მოდელების "მასშტაბების ზრდის" (Scaling) ბუმში აქტიურად ჩაერთნენ.

AI კომპანიებმა საკუთარი მოდელები ახალი ხელსაწყოებით აღჭურვეს, მათ შორის, ინტერნეტში ინფორმაციის მოძიების უნარითა და მომხმარებელთან წარსული საუბრების გახსენების ფუნქციით. ასევე შესაძლებელი გახდა მოდელებთან ელექტრონული ფოსტის, ბრაუზერებისა თუ კალენდრების დაკავშირება. დაიწყო AI მოდელების ვებბრაუზერებში ინტეგრირებაც.

კომპანია OpenAI-მ, რომელმაც წელს რესტრუქტურიზაცია დაამთავრა და კაპიტალის მოსაძიებლად მოგების ლიმიტები მოიშორა, ChatGPT-ს ახალი მოდელები გამოუშვა.

(JOEL SAGET/Getty Images)

შედარებისთვის, 2019 წელს GPT-2 მოდელს გამუდმებით უჭირდა მრავალსაფეხურიანი დავალებების შესრულება და მიცემული ინსტრუქციების დაცვა - თუ ეტყოდი, რომ სამწინადადებიანი პასუხი დაეწერა, დიდი ალბათობით, ორ, ოთხ ან მეტ წინადადებას მოგწერდა და პასუხიც ზოგადად ბუნდოვანი იქნებოდა.

2023 წლის მარტში კი GPT-4 მოდელმა ადვოკატთა საკვალიფიკაციო გამოცდაზე ტესტის გამვლელ ადამიანთა 90%-ზე უკეთესი შედეგი აჩვენა. ხოლო რამდენიმე კვირის წინ, GPT-5-ის გამოშვებამდე, OpenAI-ს აღმასრულებელი დირექტორი, სემ ალტმანი ირწმუნებოდა, რომ აღნიშნული მოდელი "ყველა ჩვენგანზე ჭკვიანი" იქნება.

ამასთან, 2025 წელს გაორმაგდა ChatGPT-ს მომხმარებელთა რაოდენობაც, რამაც მსოფლიო მოსახლეობის 10% შეადგინა - ეს ყოველკვირეულად 800 მილიონ მომხმარებელზე მეტს გულისხმობს. ამბიციების ზრდასა და მოდელების გაუმჯობესებასთან ერთად კი არის საუბრები იმაზეც, რომ OpenAI პირველად საჯარო შეთავაზებას (IPO) მომდევნო წელს ჩაატარებს, რაც ნიშნავს, რომ კომპანიის აქციები შესაძლოა, მალე საჯაროდ გაყიდვადიც გახდეს.

AI შესაძლებლობების მხრივ მნიშვნელოვანი წინსვლა ჰქონდა Google-ის Gemini 3.0-საც, რომელმაც გაუმჯობესებული "მსჯელობა" აჩვენა, ხოლო NotebookLM-ის, Gemini აპლიკაციისა და გუგლის სხვა პლატფორმების უფრო სწრაფი, ეფექტიანი მუშაობა უზრუნველყო.

ასევე შეამჩნევდით, რომ Google-ის ძებნის გამოყენებისას გვერდის თავში მომხმარებლის მოთხოვნაზე პასუხის გაცემა Gemini AI-მაც დაიწყო. Google-მა წარადგინა Gemini-ს საინტერესო ახალი მოდელი, Nano Banana-ც, რომელსაც ტექსტური პასუხების გარდა სურათების დამუშავება, აღქმა და გენერირებაც შეუძლია, რეალურ დროში ინფორმაციის მოძიებასთან ერთად.

სწრაფად განვითარდა ილონ მასკის კომპანია xAI-ს მოდელი Grok-იც, რომლის სურათების ამოძრავების (ან ზოგიერთისთვის "გაცოცხლების") ფუნქციამაც წელს ინტერნეტი ვირუსულად მოიცვა.

ამასთან, მარტში მასკის პლატფორმა X-მა დაამატა ფუნქცია, რომელმაც მომხმარებლებს პოსტის კომენტარებში Grok-სთვის კითხვების დასმისა და ფაქტების გადამოწმების საშუალება მისცა. მასკმა ასევე წამოიწყო ღია წყაროს პროექტი Grokipedia, რომლის მიზანიც ხელოვნურ ინტელექტზე მომუშავე ენციკლოპედიის შექმნაა, როგორც Wikipedia-ს ალტერნატივა.

რბოლისთვის ფეხის აწყობა სცადა მარკ ზაკერბერგმაც, რომლის კომპანია Meta-მ Messenger-ში დაამატა AI ჩატბოტი, რომელსაც ჩატშივე შეუძლია სხვადასხვა დავალებების შესრულება, მათ შორის, სურათების გენერირება, კითხვებზე პასუხის გაცემა და საუბრების შეჯამება.

პარალელურად, მედიაში გავრცელდა ინფორმაცია, რომ Meta-მ კადრების მოსაზიდად სხვა კონკურენტ კომპანიებში მომუშავე AI ექსპერტებს ასობით მილიონი დოლარის ანაზღაურების პაკეტები შესთავაზა, რაც პროფესიონალი ფეხბურთელების შესასყიდად გადახდილ თანხებს უტოლდება.

თავის მხრივ, კომპანია Anthropic-მა წლის დასაწყისში წარადგინა შთამბეჭდავი მოდელი Claude Code, რომელიც, მომხმარებლების თქმით, კარგად ართმევს თავს კოდის წერის დავალებებს. ამასთან, შესაძლებელია ვებ ინტერფეისით მოხმარების გარდა მოდელის კომპიუტერზე დაყენებაც.

საინტერესოა ისიც, რომ კომპანიის ინჟინრებმა Claude Code-ის გამოყენება თავად მოდელის გასაუმჯობესებლად დაიწყეს და Anthropic-ის წარმომადგენლების თქმით, Claude უკვე თავისი მოდელისთვის განკუთვნილი კოდის თითქმის 90%-ს თავადვე წერს.

ინდუსტრიაში კოდის წერის მხრივ გამოირჩევა 2023 წელს დაარსებული კომპანია Anysphere-ის მოდელი Cursor-იც, რომელიც წელს დეველოპერებისთვის ძლიერ ასისტენტად იქცა. გამოცემა TIME-ის მიხედვით, 2025 წლის ბოლოსკენ Claude Code და Cursor იმდენად ძლიერ მოდელებად ჩამოყალიბდნენ, რომ მოწინავე AI კომპანიების ინჟინრები მათ სამუშაოს თითქმის ყველა ასპექტში იყენებდნენ.

ყოველივე ამ პროგრესის ზურგის ქარი კი უდავოდ კომპანია Nvidia იყო, რომელიც საბაზრო კაპიტალიზაციით წელს პირველი $5-ტრილიონიანი კომპანია გახდა, რითაც მან მსოფლიოში ყველაზე ღირებული კომპანიის ტიტულიც მოიპოვა.

მიმდინარე AI ბუმის ფონზე კომპანიას დომინანტური კონტროლი აქვს მაღალტექნოლოგიურ ჩიპებზე, რომლებიც, აღმასრულებელი დირექტორის, ჯენსენ ჰუანგის თქმით, "ყველა ინდუსტრიას სჭირდება" და რომლებსაც "ყველა კომპანია იყენებს." ინტერნეტ მიმებში ხშირად Nvidia ტიტან ატლასადაც კი არის წარმოჩენილი, რომელსაც AI რევოლუცია და ინდუსტრიის მოწინავე კომპანიები მხრებით უჭირავს.

(Patrick T. Fallon / AFP - Getty Images)

ინდუსტრიის ხერხემლის როლის თამაშს თან ახლავს მოწინავე AI კომპანიებთან უპრეცედენტო ღირებულების გარიგებებიც. გავრცელებული ინფორმაციით, ე.წ. "შესანიშნავი შვიდეულის" (Nvidia, Microsoft, Apple, Alphabet, Amazon, Meta და Tesla) კაპიტალური ხარჯები ყოველ კვარტალში $110 მილიარდს აღემატება და ჯამური რაოდენობის დიდი ნაწილი, თითქმის ორი-მეხუთედი, დანარჩენი ექვსი კომპანიის მხრიდან Nvidia-ს გრაფიკული პროცესორების (GPU) შესყიდვაზე მოდის. ამასთან, ზოგადად აღნიშნული კომპანიების კაპიტალური ხარჯები, ორი წლის წინანდელ მაჩვენებელთან შედარებით, დაახლოებით სამჯერ არის გაზრდილი.

AI ციებ-ცხელება

AI რევოლუცია უბრალოდ სპეკულაცია ან ვინმეს ფანტაზიის ნაწილი აღარაა. ჩვენ რეალურ დროში ვხედავთ AI ინდუსტრიაში შემავალ მასობრივ ინვესტიციებს, ხოლო AI ინფრასტრუქტურის აშენების შესახებ დისკუსიები ხანდახან ეროვნულ დონეზე იწყება და ზოგიერთის ფანტაზიით, ჩვენი პლანეტის ორბიტასა თუ მთვარეზე მონაცემთა ცენტრების აშენების იდეებით მთავრდება.

ამასთანავე, AI-ში ფულის ჩადება ხდება არა მხოლოდ მოწინავე კომპანიების მხრიდან, არამედ დიდწილად მთავრობების დაფინანსებითაც. ხოლო ამ ტექნოლოგიის განვითარებაში მთავრობების მხრიდან მზარდი ჩართულობა ახალ შეხების წერტილებს აჩენს, რაც, თავის მხრივ, გეოპოლიტიკური დაძაბულობის გამწვავებას განაპირობებს. ბირთვული იარაღის გამოგონების შემდეგ ხელოვნური ინტელექტი ზესახელმწიფოებს შორის კონკურენციაში ყველაზე მნიშვნელოვან საშუალებად ითვლება.

(Jim Watson/AFP via Getty Images)

2025 წლის დეკემბერში გამოცემა Reuters-მა ჩინეთის "მანჰეტენის პროექტის" შესახებ ექსკლუზიური სტატია გამოაქვეყნა. გამოცემის მიხედვით, ჩინელმა მეცნიერებმა ქალაქ შენჭენის ლაბორატორიაში შექმნეს მანქანა, რომელსაც ხელოვნური ინტელექტის სისტემების, სმარტფონებისა და სამხედრო იარაღისთვის საჭირო მაღალტექნოლოგიური ნახევარგამტარი ჩიპების წარმოება შეუძლია.

წყაროების თქმით, ნიდერლანდური კომპანია ASML-ის ყოფილი ინჟინრებისგან დაკომპლექტებულმა გუნდმა ლაბორატორიაში უკუინჟინერიის მეშვეობით შეძლეს ASML-ის ექსტრემალური ულტრაიისფერი ლითოგრაფიული (EUV) მანქანების შექმნა. Reuters წერს, რომ EUV მანქანები ე.წ. "ტექნოლოგიური ცივი ომის" ცენტრალურ ნაწილს წარმოადგენენ.

თავის მხრივ, აშშ ამჟამად იმაზე მეტ თანხას (დაახლოებით მშპ-ს 1.3%-ს) ხარჯავს ხელოვნურ ინტელექტზე, ვიდრე თავის დროზე მანჰეტენის პროექტზე ან აპოლოს კოსმოსურ პროგრამაზე ხარჯავდა, რომელთა დასაფინანსებლადაც თავის დროზე, შესაბამისად, მშპ-ს 0.4% და მშპ-ს 0.8% იყო გამოყოფილი.

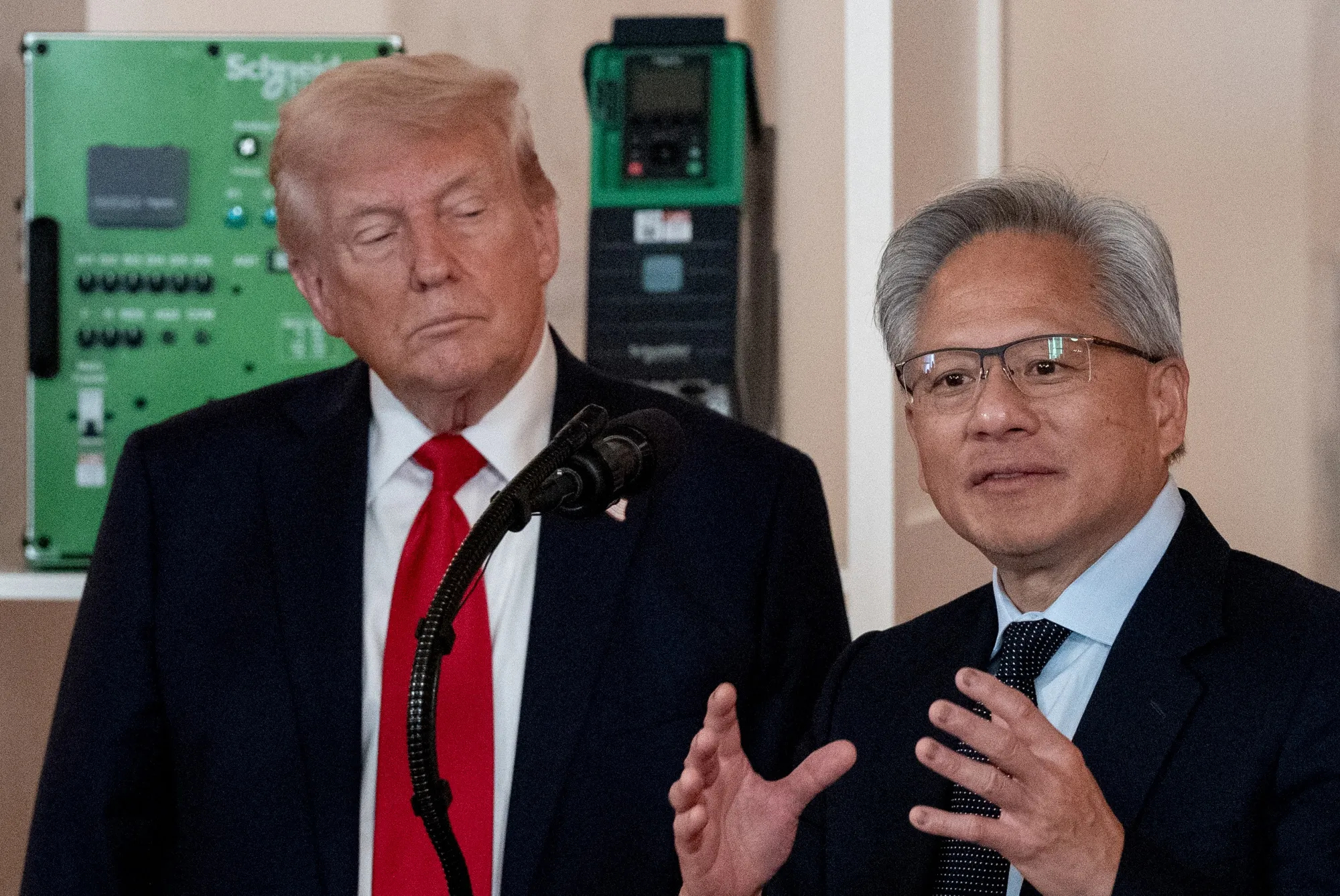

ამასთანავე, მეორე ვადით გაპრეზიდენტების შემდეგ აშშ-ს პრეზიდენტმა დონალდ ტრამპმა პირველივე კვირაში ხელი მოაწერა აღმასრულებელ ბრძანებებს, რომლებითაც ტრამპმა AI მიმართულებით მისი წინამორბედის, ჯო ბაიდენის, უფრო ფრთხილ პოლიტიკას დაუსვა წერტილი. ხოლო ტრამპის ენერგეტიკის მინისტრმა, კრის ვრაითმა, მოგვიანებით AI-ს "ტრამპის ადმინისტრაციის ნომერ პირველი მეცნიერული პრიორიტეტი" უწოდა.

საგადასახადო და საბიუჯეტო კანონპროექტში ტრამპმა დაამტკიცა კონგრესის მიერ AI დაფინანსების სახით გამოყოფილი $1 მილიარდი. ამასთან, პენტაგონმა მასობრივი - ზოგიერთ შემთხვევაში $200 მილიონამდე - კონტრაქტები დადო მოწინავე AI კომპანიებთან, მათ შორის, OpenAI-სთან, xAI-სთან, Anthropic-თან და Google-თან.

ტრამპის ადმინისტრაციამ ასევე გამოაცხადა მანჰეტენის პროექტის მსგავსი ბუნდოვანი, მაგრამ ამბიციური ინიციატივა Genesis Mission, რომელიც AI-ს გამოყენებით მეცნიერული პროგრესის ასწრაფებას ისახავს მიზნად.

2025-ში ჩინეთთან სავაჭრო დაძაბულობის გაუარესების პარალელურად აშშ-ს პოლიტიკა Nvidia-ს ჩიპების მიმართ შეზღუდვებსა და კომპანიის საქმეებში ჩარევით გარიგებების დადებას შორის მერყეობდა. ტრამპის სატარიფო ომის ფონზე თეთრმა სახლმა იანვარში ჯერ საექსპორტო კონტროლი გამოაცხადა AI ჩიპებზე, რასთან დაკავშირებითაც Nvidia-მ ტრამპის ადმინისტრაცია გააფრთხილა, რომ აღნიშნული ნაბიჯი "აშშ-ს ლიდერობას" დაასუსტებდა.

(Ken Cedeno/UPI/Bloomberg)

ხოლო აპრილში ტრამპმა ახალი საექსპორტო ლიცენზიების საჭიროება დააწესა ჩინური ბაზრისთვის განკუთვნილ H20 ჩიპებზე, რომლებიც კომპანიის სხვა მაღალტექნოლოგიურ ჩიპებზე უფრო სუსტ მოდელად ითვლებოდა.

ივლისში თეთრმა სახლმა კურსი იცვალა და მომდევნო თვეს აშშ-ს მთავრობამ ამერიკულ კომპანიებთან - Nvidia-სთან და AMD-სთან - საკმაოდ უჩვეულო შეთანხმება დადო, რომლის ფარგლებშიც ტექნოლოგიური კომპანიები [დათანხმდნენ](http://tbl.ge/7a5f), რომ ჩინეთში გაყიდული ჩიპების შემოსავლების 15%-ს მთავრობას გადაუხდიდნენ.

2025 წლის ბოლოსკენ კი ტრამპმა Nvidia-ს ნება დართო, ჩინეთში უფრო ძლიერი ტიპის H200 ჩიპები გაეყიდა, თუმცა ჩინეთმა, თავის მხრივ, ჩიპების მწარმოებლებს დაავალდებულა, რომ ახალი ჩიპების წარმოებაში ადგილობრივი აღჭურვილობის, სულ მცირე, 50% გამოიყენონ, რაც გავრცელებული ცნობებით, ჩინეთის მხრიდან ჩიპების კუთხით თვითკმარობის პოლიტიკისკენ გადადგმული მნიშვნელოვანი ნაბიჯია.

ამას გარდა, ტრამპის მხრიდან მოწოდებების შემდეგ, ჰუანგის Nvidia-მ ისტორიაში პირველად მაღალგანვითარებული AI ჩიპების წარმოება აშშ-ში, არიზონის TSMC-ის ქარხანაში, დაიწყო.

ინაუგურაციის შემდეგ ტრამპმა ასევე თეთრ სახლში ცერემონიულად გამოაცხადა კერძო კომპანიების ერთობლივი პროექტი Stargate, რომელიც Oracle-ს, SoftBank-სა და OpenAI-ს აერთიანებს და პროექტის ფარგლებში მოელიან, რომ AI ინფრასტრუქტურაში 500 მილიარდამდე ინვესტიციის ჩადება მოხდება.

ამ მხრივ საინტერესოა ის ფაქტი, რომ Stargate-ის გამოცხადების შემდეგ, პროექტის მკვეთრი კრიტიკა ჯერ კიდევ ტრამპის ადმინისტრაციაში მყოფმა ილონ მასკმა დაიწყო, რომელმაც $500-მილიარდიანი ინვესტიციის დაპირება კითხვის ნიშნის ქვეშ დააყენა.

"მათ რეალურად ფული არ აქვთ. SoftBank-ს $10 მილიარდზე ბევრად ნაკლები აქვს გარანტირებული. ეს სანდო წყაროდან ვიცი." - წერდა მასკი X-ზე.

(Michael Kovac/Getty Images for Vanity Fair)

ერთი შეხედვით, მასკის მხრიდან ასეთი რიტორიკა შესაძლოა, AI ინდუსტრიის კონკურენტ კომპანიებს შორის კორპორაციულ დაპირისპირებად მოგვჩვენებოდა, თუმცა, ამ ეპიზოდმა კიდევ ერთხელ გამოააშკარავა AI ინდუსტრიაში არსებული დიდი ხნის შიშები იმგვარ ინვესტიციებთან დაკავშირებით, რომლებიც არ იყო დაფუძნებული ფინანსურ რეალობაზე.

პირველ რიგში აღსანიშნავია, რომ მაშინ, როცა OpenAI-ს სემ ალტმანი კონტინენტური მასშტაბის ინფრასტრუქტურულ პროექტებზე საუბრობს, რომლებიც AI სისტემების გამოთვლითი შესაძლებლობების გაფართოებას უნდა მოემსახუროს, კომპანიის შემოსავლები 2025-ში დაახლოებით $13 მილიარდი იყო, ხოლო აღებული გრძელვადიანი ვალდებულებები ჯამში, სხვადასხვა ცნობებით, $1 ტრილიონსაც კი აღწევს.

პარალელურად, AI ინდუსტრიის მოწინავე კომპანიებთან მიმართებით მარკეტის დამკვირვებლებს შორის მთავარი შიშია, რომ კომპანიები ინვესტიციების მხრივ ერთგვარ "წრეზე სიარულში" არიან ჩართულნი, რაც საბოლოო ჯამში შემოსავლებსა და ინვესტიციებს შორის განსხვავების პოვნას ართულებს.

ამის ერთ-ერთი მაგალითია Nvidia-სა და OpenAI-ს ურთიერთობა, რომლის ფარგლებშიც Nvidia $100 მილიარდამდე ინვესტიციას დებს OpenAI-ში, რომელიც, თავის მხრივ, ისევ Nvidia-ს ჩიპებზეა დამოკიდებული. ამგვარად, შეიძლება ითქვას, რომ Nvidia ერთდროულად OpenAI-ს ინვესტორიც და ჩიპების მიმწოდებელიცაა.

ანალოგიური შემთხვევაა CoreWeave-თანაც. OpenAI-ს აღებული აქვს ვალდებულება, რომ დროთა განმავლობაში კომპანიისგან ათეულობით მილიარდი დოლარის პროცესორებს იყიდის, თუმცა, OpenAI-მ CoreWeave-ის IPO-მდე მასში დაახლოებით $350 მილიონის ინვესტიცია ჩადო, რითაც კომპანიის წილში შევიდა. პარალელურად, CoreWeave OpenAI-ს ინვესტიციების დამსახურებით ვალის აღებას მარტივად ახერხებს და თავადაც Nvidia-ს პროცესორებს ყიდულობს.

თავად ალტმანი ასევე ყურადღებას ამახვილებს იმ ფაქტზე, რომ ზოგჯერ OpenAI ამა თუ იმ კომპანიას ხვდებოდა და მოგვიანებით მათი აქციების ფასი დღეში 15-20%-ით იზრდებოდა, რაც ალტმანის თქმით, "სიგიჟე" იყო და არაჯანსაღ მდგომარეობაზე მეტყველებდა. ამიტომ, OpenAI-ს აღმასრულებელი დირექტორი დადებითად აფასებს ამჟამად ბაზარზე უფრო მეტად სკეპტიკურ და რაციონალურ განწყობებს.

ამ ფონზე არსებობს შიშები, რომ ინდუსტრია ე.წ. "AI ბუშტში" იმყოფება, ამის შესაფასებლად კი ისტორიკოსი ჩარლზ კინდელბერგერის ხუთეტაპიანი მოდელის გამოყენება შეიძლება: 1. ეკონომიკური გარემოებების გარკვეული ცვლილება ზოგიერთი კომპანიისთვის ახალ, მომგებიან შესაძლებლობებს ქმნის. 2. იწყება ეკონომიკური ბუმი და გადამეტებული ვაჭრობა, რადგან მოგებაზე მზარდი მოლოდინი აქციების ფასების მკვეთრ ზრდას იწვევს. 3. ბაზარზე ბატონობას იწყებს სპეკულაცია და ფუნდამენტური პრინციპებისგან დაშორებული აქციების ფასები ქმნის ეიფორიას. ბუმში ერთვებიან ახალი ინვესტორები და ჭარბობს თაღლითობა. 4. ინდუსტრიის წარმომადგენლები ხვდებიან, რომ ფასები არარეალისტურია და იწყებენ ლიკვიდაციას. 5. ბაზრისადმი ნდობა ვარდება, იწყება პანიკა და ინვესტორები ფასის მიუხედავად აქციების გაყიდვას იწყებენ, რაც "ბუშტის" გახეთქვით მთავრდება.

თუმცა, ე.წ. "AI ბუშტის" შესახებ საუბრისას ამერიკელი მეწარმე და PayPal-ის, Palantir-ისა და Founders Fund-ის დამფუძნებელი, პიტერ თილი, რომელიც AI ინდუსტრიაში გავლენიან ფიგურად ითვლება, ამბობს, რომ ამ კითხვას ევროპელები მას ხშირად უსვამენ, რაც იმაზე მეტყველებს, რომ ისინი სარისკო ნაბიჯების გადადგმას არიდებენ თავს.

"თუ ბუშტია, მაშინ ადამიანები ზედმეტად ბევრ ფულს ხარჯავენ AI-ზე, ზედმეტ მონაცემთა ცენტრებს აშენებენ და ძალიან ბევრ ჩიპებს ყიდულობენ და საბოლოოდ აქედან კლებად სარგებელს მივიღებთ. [...] მაგრამ იქნებ პირიქითაა, სადაც AI-ს მაღალი სარგებელი მოაქვს, და იძლევა გარკვეული სამუშაო პროცესების ავტომატიზაციისა და გაუმჯობესებული პროდუქტიულობის შესაძლებლობას."

თილის თქმით, მაკროეკონომიკური გადმოსახედიდან ხელოვნური ინტელექტის ეკონომიკური ზრდა გაგრძელდება. ის ასევე გვაფრთხილებს, რომ მრავალი დასაქმებული ადამიანისთვის AI ნულოვანი თამაშის ტოლფასი იქნება და ადამიანურ სამუშაო ძალასთან მიმართებით მას "უფრო ჩანაცვლებითი" როლი ექნება, ვიდრე - "შემავსებელი."

უმართავი მოლოდინები

ამგვარად, AI სისტემების შემქმნელ კომპანიების წლევანდელ პროგრესს რომ გადავხედოთ, მარტივად გასაგები იქნება ის, თუ რატომ მიიპყრეს სცენაზე მდგომმა ხელოვნური ინტელექტის ტექგიგანტებმა ყურადღება მაშინ, როცა 2025 წელი სავსე იყო გეოპოლიტიკური დაძაბულობებით, ომითა და მსოფლიო წესრიგში სეისმური რყევებით.

თუმცა, ტექნოლოგიურ პროგრესთან ერთად, არანაკლებ საჭიროა ყურადღების გამახვილება იმაზე, თუ რაოდენ თამამად და თავდაჯერებით ხდება AI-ს მომავლის განხილვა და რა გავლენა აქვს ამას ხალხის მოლოდინებზე, პოლიტიკასა და ეკონომიკაზე.

ტექ ინდუსტრიის წამყვანმა ფიგურებმა, რომლებიც უშუალოდ მონაწილეობენ თანამედროვე "ოქროს ციებ-ცხელებაში", საკმაო ენთუზიაზმითა და სერიოზულობით დაიწყეს იმის დაპირება, რომ ხელოვნური ინტელექტის განვითარება ადამიანების ახალი ხელსაწყოებით მომარაგებასთან ერთად, ძირეულად არა მხოლოდ საზოგადოებას, არამედ ჩვენი მხრიდან ადამიანობის შესახებ არსებულ წარმოდგენებსაც შეცვლის.

მსგავსი დაპირებები კი არსებითად უპრეცედენტოა, რადგან ისინი რეალურ ამბიციებზე, კონკრეტულ ინვესტიციებსა და ზოგიერთისთვის უკვე არსებულ შესაძლებლობებზეა დამყარებული.

სულ რამდენიმე წლის წინ რთული წარმოსადგენი იქნებოდა, რომ Nvidia-ს აღმასრულებელი დირექტორი, ჯენსენ ჰუანგი დაიწყებდა იმაზე ლაპარაკს, რომ სამომავლოდ ინტელექტი აღარ იქნება მწირი რესურსი, არამედ "ჭკვიანობა" ჩვეულებრივი მოხმარების საგნად იქცევა, რადგან, მისი თქმით, AI-ს ადამიანზე უკეთ შეუძლია სხვადასხვა ტესტისა თუ პროფესიული დავალების შესრულება.

გაუგონარი იქნებოდა იმის რეალურად წარმოდგენაც, რომ ტექნოლოგიური ინდუსტრიის მნიშვნელოვანი ნაწილი ენთუზიაზმით შეხვდებოდა OpenAI-ს სემ ალტმანის მიერ გამოთქმულ იმედს, რომ კაცობრიობა მალე შექმნის ხელოვნურ ზოგად ინტელექტს (AGI), რაც გულისხმობს ხელოვნური ინტელექტის უნარს, სხვადასხვა სფეროში ადამიანის მსგავსად შეისწავლოს, იმსჯელოს და გადაჭრას პრობლემები.

(Tang Yanjun/China News Service/VCG via Getty Images)

ცხადია, მსგავს საკითხებზე შიშები წარსულშიც არსებობდა, მაგრამ ეს მხოლოდ ფანტაზიის ნაწილად, შესაძლებლობათა განზომილებაში რჩებოდა და ცოტა თუ იფიქრებდა, რომ 21-ე საუკუნის პირველი მეოთხედის მიწურულს ტექნოლოგიური განვითარების სათავეში მყოფი პირები სერიოზულად დაიწყებდნენ გრძელვადიანი სპეკულაციების ხარისხიდან აღნიშნული რისკების ჩამოყვანას და მათი რეალურ ტექნოლოგიურ გამოწვევებად განხილვას.

შედეგად, კაცობრიობა დღეს ალბათ ისტორიაში ერთ-ერთი ყველაზე ღრმა იდენტობის კრიზისის წინაშე დგას იმ ფონზე, როცა AI სისტემების გაუმჯობესებას ადამიანებსა და AI მოდელებს შორის ინტელექტუალური შესაძლებლობების მზარდად გათანაბრება მოაქვს. ეს პროცესი უკვე მუდმივმოქმედია და რეალურ დროში ვხედავთ მის გავლენას ადამიანებზე, ეკონომიკასა და ზოგადად ყოფა-ცხოვრებაზე.

გამოწვევა კიდევ უფრო მომძლავრებული იქნება ჩვენი შთამომავლებისთვის. ბოლო დროს შემხვდა საინტერესო დაკვირვება: წარსულში მშობლები ბავშვებს არიგებდნენ, ყოფილიყვნენ იმ ოთახში, სადაც მათზე ჭკვიანი ადამიანები არიან. დღესდღეობით ეს პირობა გარკვეულწილად უკვე ნებისმიერ ოთახში შეიძლება იყოს დაკმაყოფილებული, სადაც ტელეფონი ან ლეპტოპი გვხვდება.

AI-ს მომავალთან დაკავშირებული წარმოდგენები ძირითადად ან უტოპიურ ეკონომიკურ დაპირებებსა და დაჩქარებული მეცნიერული კვლევების აღთქმებს მოიცავს, ან, მეორე მხრივ, ემყარება შიშებს, რომ ხელოვნური ინტელექტი ძლიერ ეკონომიკურ გარდაქმნასა და აქამდე არნახული მასშტაბის უმუშევრობის ტალღებს გამოიწვევს. კიდევ უფრო უკიდურეს შემთხვევაში კი გვხვდება დისტოპიური ხედვაც, რომ კაცობრიობა საბოლოოდ ხელოვნურ ინტელექტზე კონტროლს დაკარგავს და ადამიანის გამოგონება მისივე გადაშენების მიზეზი გახდება.

ინტერნეტ მომხმარებლისთვის ამგვარი კითხვების თავიდან არიდება და გაქცევა თითქმის შეუძლებელია. ყოველ ჯერზე, როცა ChatGPT-სთვის კითხვის დასმა გიწევს, ან Grok-ს საყვარელი სამახსოვრო სურათის ამოძრავებას სთხოვ, ან გხვდება სურათი, ამბავი თუ ვიდეო, რომელიც AI-თ შექმნილი სიცრუე აღმოჩნდება - მსგავსი, ერთი შეხედვით, უმნიშვნელო შემთხვევები ძალაუნებურად გონებაში ილექება და საბოლოოდ ამას გარკვეულ კითხვებამდე მივყავართ, რომლებზე პასუხის პოვნაც მარტივი არ არის.

ამიტომ, აჟიოტაჟურ მოლოდინებში გზის გასაკვალად და სწორ დასკვნებთან მისასვლელად საჭიროა პირველ პრინციპებთან დაბრუნება და AI-ს გარშემო არსებული საკითხების ფუნდამენტური განხილვა.

ჩინური ოთახი

ცხადია, საწყისი წერტილი თავად "ხელოვნური ინტელექტის" ცნებაა, რომელიც გულისხმობს მონაცემებზე გაწვრთნილი კომპიუტერული მოდელების გამოყენებას, რათა მივიღოთ მათში შემავალი მონაცემების იმგვარი გარდაქმნა, რომ ამ პროცესით მოხდეს, ჩვეულებისამებრ, ადამიანის მიერ შესრულებული დავალებების ჩანაცვლება ან დავალების შესრულებაში ადამიანის ხელშეწყობა მისი ჩანაცვლების გარეშე.

თუმცა, გზის გასაყარი იწყება კითხვიდან, შესაძლებელია თუ არა, რომ ამ პროცესში ინტელექტი, თვითშემეცნება, თვითგაგება, ან ცნობიერება არსებობდეს და, მაშასადამე, მანქანებს სუბიექტური ონტოლოგიური გამოცდილება ჰქონდეთ.

ალან ტიურინგმა ამ კითხვაზე პასუხის გასაცემად ჩათვალა, რომ კითხვა "შეუძლიათ თუ არა მანქანებს ფიქრი?" საერთოდ არ უნდა დაისვას და მისი ჩანაცვლება უნდა მოხდეს ბიჰევიორისტული (ქცევითი) ტესტით, რომელსაც მოგვიანებით ტიურინგის სახელი დაერქვა. ტესტი შემდეგნაირია: თუ კომპიუტერს შეუძლია ენის იმგვარად გამოყენება, რომ განურჩეველი იყოს ადამიანისგან, მაშინ უნდა ჩავთვალოთ, რომ ის ფლობს ინტელექტს.

თუმცა, ამერიკელი ფილოსოფოსი, ჯონ სერლი ამბობდა, რომ ინტელექტი მხოლოდ ქცევამდე ან კომპიუტერულ გამოთვლამდე არ დაიყვანება და საკითხის განხილვისას ხაზს უსვამდა განსხვავებას სინტაქსსა და სემანტიკას შორის - სინტაქსი გარკვეული წესების მიხედვით სიმბოლოების ფორმალურ მანიპულაციას წარმოადგენს. სემანტიკა კი კავშირშია მნიშვნელობასთან, რასაც სიმბოლოები გულისხმობენ.

სერლის პოზიციით, რამდენად რთულიც არ უნდა იყოს სინტაქსური სისტემა, სემანტიკა არაფრისგან ვერ გაჩნდება. მხოლოდ წესების, სიმბოლოების ან ინფორმაციის დამუშავების სისწრაფის გაზრდით ისევ და ისევ მეტი სინტაქსი გექნება და არასდროს - სემანტიკა.

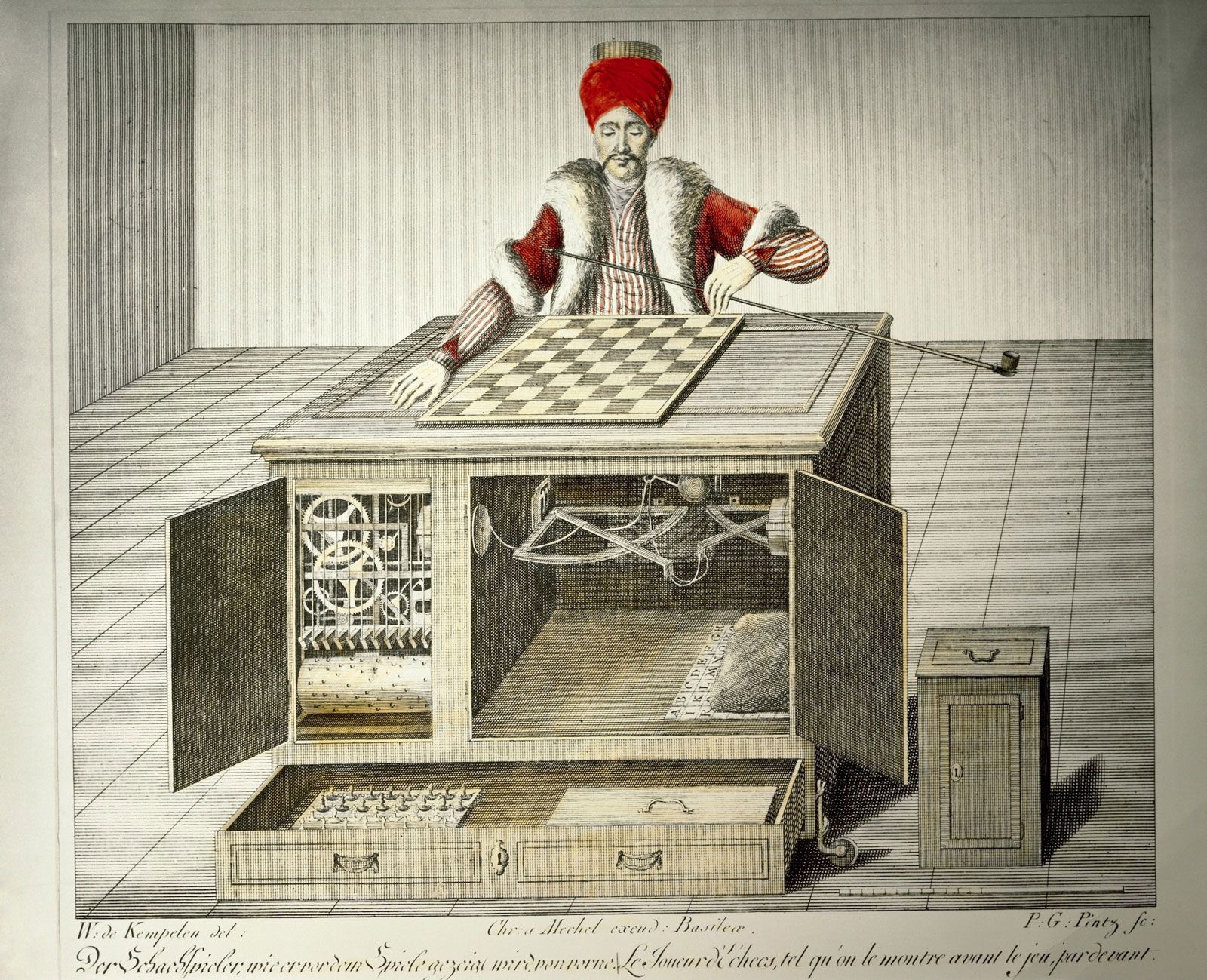

ამის საჩვენებლად სერლმა შეიმუშავა აზრითი ექსპერიმენტი, სახელად "ჩინური ოთახი". ექსპერიმენტის ფარგლებში უნდა წარმოვიდგინოთ ადამიანი, რომელიც ოთახშია გამოკეტილი და მას მხოლოდ ინგლისური ენა ესმის. მეორე ადამიანი, რომელმაც ჩინური იცის, ოთახის გარეთ იმყოფება და მას ოთახში მყოფთან კონტაქტი დახურული კარის მეშვეობით აქვს.

იგი ინგლისურად მოსაუბრეს ჩინური იეროგლიფებით დაწერილ ტექსტებს უგზავნის. ოთახში მყოფს კი თან აქვს წესების სახელმძღვანელო, რომელშიც ზედმიწევნით არის ახსნილი, თუ რა უნდა მიუსადაგოს მან თითოეულ ჩინურ იეროგლიფს. ინგლისური ენის მცოდნე ამას მხოლოდ იეროგლიფების მოხაზულობისა და ფორმის მიხედვით აკეთებს. ამასთან, წესები იმდენად კარგად არის ახსნილი, რომ მათი დაცვის შედეგად ოთახში მყოფი კარს მიღმა მდგომარე ჩინურად მოსაუბრე ადამიანს ისეთ პასუხებს აწვდის, რომლებიც ჩინურ ენაზე მოსაუბრე ადამიანის მიერ დაწერილისგან გარეგნულად არაფრით განსხვავდება.

სერლის არგუმენტი იმაში მდგომარეობს, რომ რეალურად ოთახში ჩინური არავის ესმის: არც იქ მყოფ პირს, არც შეგზავნილ ფურცლებს და არც წესების სახელმძღვანელოს - მაგრამ მთლიანი სისტემა ისე იქცევა, თითქოს ჩინური იცის. გარეთ მყოფი ადამიანისთვის, რომელსაც წარმოდგენა არ აქვს, თუ როგორ მუშაობს ოთახი შიგნიდან, მიღებული პასუხები ისეთივეა, როგორსაც ის ნამდვილად ჩინურად მოსაუბრე ადამიანისგან მიიღებდა. ამ მხრივ მისთვის შედეგი განურჩეველია, თუმცა, სერლის მიხედვით, განურჩევნლობა არ იძლევა რეალური გაგება-გააზრების გარანტიას.

ოთახში მყოფი ადამიანი მხოლოდ ზედმიწევნით იცავს სინტაქსურ წესებს. სახელმძღვანელოს მეშვეობით იგი ახერხებს ჩინური იეროგლიფების მანიპულაციას ისე, რომ სწორ პასუხებს იძლევა. გარედან პროცესი ჩინურის ცოდნად აღიქმება - თითქოს შიგნით მყოფ ადამიანს ნამდვილად ესმის ენა, მაგრამ შიგნით თუ ჩავიხედავთ ნათელია, რომ მსგავსი არაფერი არ ხდება. ოთახი წარმოადგენს სისტემას, რომელსაც აქვს სინტაქსი, მაგრამ არ გააჩნია სემანტიკა.

სერლი ასევე უარყოფდა იმ არგუმენტსაც, რომ ჩინური "მთლიან სისტემას" ესმის და არა - მის შემადგენელ ნაწილებს. თუკი სისტემის არცერთი ნაწილი არ ანიჭებს სიმბოლოებს მნიშვნელობას, იმის თქმა, რომ მნიშვნელობის გააზრება სისტემის დონეზე არსებობს, აზრსმოკლებულია.

"არავინ ფიქრობს, რომ მე-5 დონის ხანძრის კომპიუტერული სიმულაცია სამეზობლოს გადაწვავს ან რომ კოკისპირული წვიმის კომპიუტერული სიმულაცია ყველას გაგვლუმპავს." - წერდა სერლი 1980 წელს. მისი აზრით, კომპიუტერული პროგრამებისთვის ფსიქოლოგიური მდგომარეობის მიკუთვნება მიუღებელი იყო.

"რატომ უნდა იფიქროს ვინმემ, რომ გააზრების კომპიუტერულ სიმულაციას რეალურად რაიმე ესმის?" - ამბობდა სერლი, რომლისთვისაც ტვინი და კომპიუტერის აპარატული აღჭურვილობა (ე. წ. "ჰარდვეარი"), ან გონება და პროგრამული უზრუნველყოფა, ერთმანეთთან შედარებადი არ იყო.

სერლი უფრო შორსაც წავიდა. თავისი პოზიციის განვითარების მიზნით მან შემოგვთავაზა, წარმოგვედგინა შემთხვევა, როცა ოთახში მყოფ ადამიანს შესანიშნავი მეხსიერება და ინტელექტი აქვს, რისი წყალობითაც ის სახელმძღვანელოს წესების დამახსოვრებას ბრწყინვალედ ახერხებს.

ასეთ დროს ექსპერიმენტიდან შეგვიძლია, ოთახიც გავაქროთ და ადამიანს თავისუფლად გადაადგილების საშუალება მივცეთ. შედეგი იგივეა: ამ ადამიანს კვლავ არ "ესმის" ჩინური, რადგან არ აქვს გააზრებული იეროგლიფების მნიშვნელობა. ეს სახეცვლილი ექსპერიმენტი უფრო თვალსაჩინოდ მიესადაგება თანამედროვე LLM-ებს.

ფიქრის ილუზია

ამის მიუხედავად, დღესდღეობით AI ტექნოლოგიის გავლენიანი ფიგურებისგან ხშირად გვესმის პროგნოზები, რომლებიც საწინააღმდეგოს ამტკიცებენ და ხელოვნურ ინტელექტსა და გონებას შორის ზღვრის წაშლას მოასწავებენ.

მათ შორისაა "ხელოვნური ინტელექტის ნათლიმამად" წოდებული ჯოფრი ჰინტონი, რომელმაც CBS-ის გადაცემა "60 წუთში" აღნიშნა, რომ მისი აზრით, AI სისტემებს აქვთ გააზრების უნარი, არიან ინტელექტუალურები, გააჩნიათ საკუთარი გამოცდილება და შეუძლიათ, ადამიანების მსგავსად, ამ გამოცდილებებზე დაყრდნობით გადაწყვეტილებების მიღება. მისი თქმით, ამ ეტაპზე AI "ალბათ" თვითაღქმას არ ფლობს, თუმცა, სამომავლოდ მათ ცნობიერება ექნებათ.

"ადამიანებისგან მოისმენთ, რომ ისინი [AI სისტემები] მხოლოდ ავტომატურად ავსებენ [წინადადებებს]. [რომ] ისინი მომდევნო სიტყვის პროგნოზირებას ცდილობენ და მხოლოდ სტატისტიკას იყენებენ. სიმართლეა, რომ ისინი მხოლოდ შემდეგი სიტყვის პროგნოზირებას ცდილობენ, მაგრამ რომ დაფიქრდე, მომდევნო სიტყვის პროგნოზირებისთვის წინადადებები უნდა გესმოდეს. ასე რომ, წარმოდგენა, რომ ისინი მხოლოდ სიტყვებს პროგნოზირებენ და ამიტომ ისინი ინტელექტუალურები არ არიან, სიგიჟეა. რეალურად ინტელექტუალური უნდა იყო, რომ სწორად იპროგნოზირო შემდეგი სიტყვა." - ამბობს ჰინტონი და ამატებს, რომ მომავალში ინტელექტით ადამიანი დედამიწაზე რიგით მეორე არსება გახდება.

AI-სთვის ანალოგიურ განვითარების გზას ხედავს OpenAI-ს თანადამფუძნებელი და თანამედროვე ღრმა დასწავლის ერთ-ერთი არქიტექტორი, ილია სუცკევერიც, რომელმაც 2023-ში OpenAI-ს აღმასრულებელი დირექტორის თანამდებობიდან სემ ალტმანის გადაყენება წარუმატებლად სცადა, რის შემდეგაც ერთი კვირის შემდეგ კომპანიის სათავეში დაბრუნებულმა ალტმანმა იგი დირექტორთა საბჭოდან გაუშვა.

(Jim Wilson/The New York Times)

"მოვა დღე, როდესაც ხელოვნური ინტელექტი გააკეთებს ყველაფერს, რასაც ჩვენ ვაკეთებთ. არა მხოლოდ ნაწილს, არამედ - ყველაფერს. AI შეძლებს, გააკეთოს ყველაფერ, რისი სწავლაც მე ან თქვენ შეგიძლიათ. საიდან ვიცი ეს? რატომ ვარ ასე დარწმუნებული? მიზეზი ისაა, რომ ყველა ჩვენგანს აქვს ტვინი და ტვინი ბიოლოგიური კომპიუტერია, სწორედ ამიტომ. ჩვენ ტვინი გვაქვს, ტვინი ბიოლოგიური კომპიუტერია. ასე რომ, რატომ ვერ გააკეთებს იგივეს ციფრული ტვინიც?" - თქვა სუცკევერმა 2025 წლის ივნისში ტორონტოს უნივერსიტეტში სიტყვით გამოსვლისას.

მსგავსი წარმოდგენები სერლმა გააერთიანა პოზიციაში, რომელსაც მან "ძლიერი AI" დაარქვა. ამ გადმოსახედიდან შესაფერისად დაპროგრამებული ციფრული კომპიუტერი არა მხოლოდ გონების სიმულირებას ახდენს, არამედ რეალურ გონიერებას ფლობს. სერლის მიხედვით, "ძლიერი AI-ს" პოზიცია ეყრდნობა თეზისს, რომ შემეცნება (იგივე კოგნიცია) გამოთვლითია და სწორი პროგრამის შერჩევისა და დანერგვის შემთხვევაში გონება ნებისმიერ ფიზიკურ სისტემას შეიძლება ჰქონდეს.

ამ მხრივ ასევე საინტერესოა 2025 წლის ივნისში კომპანია Apple-ის მანქანური სწავლების ჯგუფის მიერ გამოქვეყნებული კვლევა, სათაურით "ფიქრის ილუზია," რომელშიც განხილულია, თუ რამდენად შეუძლიათ "დიდ მსჯელობის მოდელებს" (LRM) რეალურად განზოგადებადი, მასშტაბირებადი ლოგიკური მსჯელობა და არის თუ არა ეს გარეგნული "მსჯელობა" უბრალო ზედაპირული ილუზია.

Apple-თან აფილირებულმა მკვლევრებმა პირველ რიგში გააკრიტიკეს სტანდარტული მსჯელობის საზომი მაჩვენებლები (ე.წ. "ბენჩმარკები") და შექმნეს ახალი თავსატეხების მქონე გარემო-პირობები.

კვლევის მთავარი მიგნება იყო ის, რომ მოდელების ქცევის თანდათანობითი დეგრადაციის ნაცვლად, გარკვეული სირთულის მიღმა LRM-ების სისწორე სწრაფ კოლაფსს განიცდის და ხშირად თითქმის ნულამდეც ეცემა, რაც აჩვენებს, რომ ეს მოდელები ალგორითმების ან მასშტაბირებადი პროცედურების შესრულების ნაცვლად, ევრისტიკულ ნაბიჯებს ეყრდნობიან.

ევრისტიკული ნაბიჯი გულისხმობს პროგრამის მხრიდან სწრაფი, პრაქტიკული მეთოდის გამოყენებას პრობლემის "საკმარისად კარგი" (შემოკლებული) გზით გადასაჭრელად მაშინ, როცა ყველაზე სწორი გზის გამონახვას ზედმეტად დიდი დრო სჭირდება ან მისი გამოთვლა ბევრ რესურსს მოითხოვს.

ამასთან, მკვლევრებმა შენიშნეს კონტრინტუიციური ქცევაც - პრობლემების გართულებასთან ერთად, მოდელებში მსჯელობის კვალი თავდაპირველად იზრდებოდა, თუმცა, გარკვეულ ეტაპზე შემცირებას იწყებდა, ანუ მოდელი მცდელობებს წყვეტდა.

კონტრინტუიციური იმიტომ, რომ ჩვეულებისამებრ, როდესაც ადამიანის მიზანი რაიმე პრობლემის გადაჭრაა და ამოცანა მისთვის დიდ სირთულესთანაა კავშირში, იგი, მცდელობების უეცრად შეწყვეტის ნაცვლად, ამოხსნაზე უფრო მეტი ძალისხმევის დახარჯვას იწყებს. ამიტომ, მკვლევრების აზრით, მსგავსი ქცევა LRM-ებში მწყობრიდან გამოსვლის რეჟიმის არსებობაზე მიანიშნებს - რაც ნიშნავს, რომ სისტემა წინასწარ განსაზღვრულ ქცევას მიმართავს, როდესაც პროცესი არასწორი მიმართულებით მიდის.

კვლევამ ასევე აჩვენა, რომ LRM-ებს უჭირთ ზუსტი გამოთვლები და არ სწავლობენ ან არ იყენებენ მათთვის ხელმისაწვდომ ალგორითმებს მაშინაც კი, როცა პრობლემის ალგორითული გადაჭრის გზა უკვე არსებობს. ამასთანავე, მოდელები ერთსა და იმავე თავსატეხებზე არათანმიმდევრულად მსჯელობენ, ვერ ახერხებენ სტრატეგიების ხელახლა გამოყენებას და ყოველ ჯერზე მიდგომის შერჩევისას იმპროვიზაციის გზას მიმართავენ.

შესაბამისად, Apple-ის მიერ გამოქვეყნებული კვლევა ასკვნის, რომ მსჯელობის კვალი არ წარმოადგენს რეალური მსჯელობის მტკიცებულებას და ახლანდელი LRM-ები ახდენენ მხოლოდ აზროვნების სიმულირებას, ისიც სირთულის კონკრეტულ დიაპაზონში, თუმცა, ეს ვერ ითარგმნება ალგორითმულ კომპეტენტურობაში, ვინაიდან მათი ქცევა კოლაფსს განიცდის უფრო რთულ გარემოში. მაშასადამე, რასაც ამ მოდელებში ვხედავთ წარმოადგენს ეფექტურ სიმულაციას და არა - მყარ, ზოგად მსჯელობის უნარს.

AI მოდელები გამოწვევების წინაშე

აქვე ვაწყდებით მეორე პრობლემასაც. ინდუსტრიის არაერთი გავლენიანი ფიგურის შეფასებით, წახალისებით სწავლებაზე (Reinforcement Learning, იგივე RL) დამყარებული ხელოვნური ინტელექტის განვითარების ახლანდელი მიმართულება ნაკლოვანია, ვინაიდან მოწინავე LLM-ები არსებითად განსხვავდებიან ადამიანის ფსიქოლოგიისგან.

AI-სა და ტექნოლოგიის საკითხებზე ცნობილი პოდკასტის წამყვანის, დვარკეშ პატელის აზრით, მოლოდინი, რომ მომდევნო 3-5 წელიწადში ხელოვნური ზოგადი ინტელექტის (AGI) მიღწევაა შესაძლებელი შეუსაბამობაშია უმსხვილეს AI კომპანიებში გაბატონებულ პრაქტიკასთან, რომელიც არსებულ LLM-ებზე RL-ის მეშვეობით ახალი სწავლების დაშენებასა და ამგვარად მოდელების მასშტაბების გაზრდას გულისხმობს.

ადამიანებსა და ახლანდელ AI-ს შორის კი განსხვავება ისაა, რომ AI სისტემებს ახალ ხელსაწყოსთან შეხებისას, უცნობ გარემოში აღმოჩენისას ან დავალების პირველად შესრულებისას ინდივიდუალური, მათზე მორგებული წვრთნები სჭირდებათ და ერთ კონტექსტში ნასწავლი უნარების მეორეში განზოგადებას ვერ ახერხებენ. ადამიანი კი სხვანაირად იქცევა. მას არ აქვს გავლილი წინასწარი წვრთნები ყველა ხელსაწყოზე, თუმცა ცდისა და შეცდომის მეთოდის წყალობითა და მწირ უკუკავშირზე დაყრდნობით ახალი ინსტრუმენტების ათვისებას ახერხებს.

მაგალითისთვის პატელს მოჰყავს ადამიანი, რომელიც უცნობ სახლში შედის და წინასწარი წვრთნის გარეშე ახერხებს თეფშების აღებას მაშინ, როცა AI რობოტს უამრავი პრაქტიკა და ყოველგვარ უმნიშვნელო ვარიაციაზე სპეციფიკური წვრთნა სჭირდება. იგი განმარტავს, რომ ადამიანის მსგავი შესწავლის უნარის მქონე სისტემას უნდა შეეძლოს ძალზე მცირე მონაცემებზე დაყრდნობით ახალი დავალებების შესრულება; ხელახალი გაწვრთნის გარეშე უკვე ნასწავლი უნარების ახალ კონტექსტთან მორგება და ცოდნის განზოგადება; ამასთან, აუცილებელია ახალი შესაძლებლობების ინტეგრირება ძველი სტრატეგიების დავიწყების გარეშე და სემანტიკურ უკუკავშირზე დაყრდნობით შესწავლის უნარიც.

პატელის თქმით, მისთვის ძალზე დაუჯერებელია მოლოდინი, რომ "როგორღაც ავტომატიზირებული მკვლევარი ამოხსნის AGI-ს ალგორითმს, რა პრობლემასაც ადამიანები საუკუნის ნახევარზე მეტი ხნის განმავლობაში ურტყამდნენ თავს მაშინ, როცა [AI სისტემას] არ გააჩნია შესწავლის ისეთი საბაზისო შესაძლებლობებიც კი, რომლებიც ბავშვებსაც აქვთ."

ანალოგიურ პრობლემაზე ამახვილებს ყურადღებას სლოვაკური წარმოშობის კომპიუტერული მეცნიერი, ანდრეი კარპატი, რომელიც OpenAI-ს ყოფილი თანამშრომელია.

2025 წლის დიდი ენის მოდელების (LLM) შეფასებისას კარპატი ამბობს, რომ LLM-ები ახალი ტიპის ინტელექტად ყალიბდებიან, თუმცა, მისი გადმოსახედიდან, არსებული მოდელები, ერთდროულად, მოსალოდნელზე ბევრად ჭკვიანები და პარალელურად ბევრად სულელებიც არიან.

მისი განმარტებით, 2022 წლიდან მოყოლებული 2025 წლის დასაწყისამდე მოდელების გაწვრთნა ადამიანის უკუკავშირზე დამყარებული წახალისებითი სწავლების (RLHF) მიხედვით ხდებოდა. თუმცა, ყოველივე ამას წელს დაემატა შემოწმებად ჯილდოზე დამყარებული წახალისებითი სწავლების (RLVR) მეთოდი.

ფუნდამენტურ დონეზე RLHF-სა და RLVR-ს შორის განსხვავება მდგომარეობს იმაში, თუ რითი განისაზღვრება "კარგი" შედეგი. ადამიანის უკუკავშირზე დამყარებული მეთოდი გაწვრთნის პროცესში მოდელს აჯილდოებს ისეთი შედეგისთვის, რომელიც ადამიანისთვის სასურველია. მაგალითად, ადამიანები აფასებენ პასუხებს და ამბობენ, რომ "ეს უკეთესია" და შედეგად მოდელი ანალოგიური პასუხების იმიტირებას სწავლობს. RLHF მეთოდის ერთ-ერთი ყველაზე თვალსაჩინო მაგალითია, თუკი გქონიათ შემთხვევა, როცა ChatGPT-მ ორი სხვადასხვა პასუხი შემოგთავაზათ და მათგან ერთ-ერთის არჩევა გთხოვათ.

RLVR კი წვრთნის პროცესში მოდელს აჯილდოებს ისეთი შედეგისთვის, რომელიც ობიექტურად სწორია, ანუ არ საჭიროებს ადამიანის აზრს პასუხის სისწორის შესამოწმებლად. მოდელი ჯილდოს იღებს მხოლოდ იმ შემთხვევაში, თუკი პასუხის გადამოწმება ავტომატურად არის შესაძლებელი. შედეგად, აქცენტი სისწორეზეა გაკეთებული და არა - ადამიანის პრეფერენციებზე.

თუმცა, კარპატი მიიჩნევს, რომ ზოგადად წახალისებითი სწავლება (RL) პარადიგმულ აცდენაშია განსაკუთრებით ისეთ დავალებებთან მიმართებით, რომლებიც მოიცავენ კომპლექსურ შემეცნებას და, მაშასადამე, RL არაეფექტურია იმასთან შედარებით, თუ რეალურად როგორ სწავლობს ადამიანი. კარპატის გადმოსახედიდან, თანამედროვე მოდელების გაწვრთნის მეთოდები არ არის იგივე შესწავლის ალგორითმები, რასაც ადამიანები იყენებენ.

ამას გარდა, კარპატი ხაზს უსვამს, რომ როდესაც მოდელის გაწვრთნის პროცესში RLVR მეთოდი გამოიყენება, LLM-ების შესაძლებლობები, როგორც ჩანს, "პრობლემათა სივრცის" მხოლოდ ვიწრო არეალში მკვეთრად უმჯობესდება, რაც საბოლოო ჯამში არათანაბარ ოპტიმიზაციასა და შესაძლებლობებს იწვევს.

კარპატის თქმით, სწორედ არათანაბარი ოპტიმიზაციით შეიძლება აიხსნას, თუ რატომ შეიძლება თანამედროვე LLM-ები ერთდროულად თან "გენიოს პოლიმათებად" და თან "დაბნეულ, გონებრივი გამოწვევების მქონე მოსწავლედ" მოგვეჩვენოს.

საინტერესოა, რომ ამერიკელი კომპიუტერული მეცნიერი და ავტორი, ფეი-ფეი ლი თავის წიგნში "მსოფლიო, რომელსაც მე ვხედავ" ყურადღებას ამახვილებს იმ დაშორებაზე, რომელიც ადამიანების მიერ სამყაროს შესწავლასა და მანქანების მხრიდან განსაზღვრული მონაცემებიდან სწავლებას შორის არსებობს.

(Paul Chinn/San Francisco Chronicle/Getty Images)

წიგნში ლი პროექტი ImageNet-ის ფარგლებში დიდი ზომის მონაცემების შექმნის პროცესს აღწერს. ცნობისთვის, ImageNet, რომელსაც ფეი-ფეი ლი ხელმძღვანელობდა, ადამიანების მიერ ორგანიზებული სურათების მონაცემთა ბაზაა, რომლის მიზანიც კომპიუტერული ხედვის სისტემების მასშტაბური გაწვრთნა და მათთვის "ბენჩმარკების" შექმნაა.

ლის გადმოსახედიდან კვლევა უბრალოდ სურათებისა და პატერნების ამოცნობას არ ეხებოდა, არამედ ეს იყო მცდელობა, რომ მონაცემთა სახით, მომხდარიყო ბავშვის მხრიდან სამყაროს აღქმისა და გააზრების პროცესის ნაადრევი ეტაპების რეპლიკაცია.

"ისინი [ბავშვები] ნივთების ხელში აღებით, შემოტრიალებითა და სხვადასხვა კუთხიდან დანახვით ეჩვევიან განათებისა და პერსპექტივის ცვლილებებს. ისინი დამალობანას მსგავს თამაშებს თამაშობენ; სწავლობენ, რომ ობიექტები არ ქრებიან მაშინაც კი, როცა დროებით იმალებიან. ყველა ამ ინსტინქტს, რომლებიც ჩვენს ალგორითმებს მწარედ აკლდათ." - წერს ლი.

ლის თქმით, მოგვიანებით სტენფორდში მუშაობის დროს მან მანქანურ სწავლებაში ახალი მიდგომების კვლევა დაიწყო, რაც მოიცავდა ისეთ ციფრულ აგენტებსაც, რომლებიც, მისი თქმით, შექმნილნი არიან "შინაგანი ცნობისმოყვარეობით". აღნიშნულ აგენტებს ვირტუალურ გარემოში ათავსებენ, რომელიც მათ "თამაშისკენ" უბიძგებს, რაც ფეი-ფეი ლის მიხედვით, "ბავშვების მხრიდან მათ გარემოსთან ინტუიციური კავშირის დამყარების გზის არსებით ნაწილს" წარმოადგენს.

ინდუსტრიაში AI-ს ამჟამინდელ მიმართულებასთან პრობლემები აქვს თავად სუცკევერსაც, რომელიც ამბობს, რომ მოწინავე AI კომპანიების წარმოდგენაა, თითქოს ერთადერთი და უნივერსალური გამოსავალი "მასშტაბების ზრდაა".

დვარკეშ პატელის პოდკასტში სუცკევერი AI ტექნოლოგიის განვითარებას სამ ნაწილად ყოფს. მისი თქმით, 2012-2020 წლები კვლევის ეპოქა იყო. 2020-დან 2025-მდე კი "მასშტაბების ზრდის" ეპოქა, რადგან ამ პერიოდში კომპანიების განვითარების სტრატეგია ერთი სიტყვით ხასიათდებოდა: "მასშტაბირებით".

"ხალხი ამბობდა, 'ეს შესანიშნავია! უფრო მეტი მასშტაბებია საჭირო, განვაგრძოთ მასშტაბების ზრდაო.' ერთი სიტყვა: მასშტაბირება. მაგრამ ახლა მასშტაბი იმდენად დიდია. ნუთუ წარმოდგენა მართლაც ის არის, რომ ამხელაა, მაგრამ 100-ჯერ მეტირომ იყოს, ყველაფერი ბევრად განსხვავებული იქნებოდა? განსხვავებული კი იქნება, მაგრამ წარმოდგენა ნუთუ ის არის, რომ მასშტაბს თუ 100-ჯერ გაზრდი, ყველაფერი გარდაიქმნება? არ მგონია, რომ ეს სიმართლეა." - ამბობს სუცკევერი და განმარტავს, რომ "მასშტაბირების ეპოქის შემდეგ" ტექ ინდუსტრია ისევ კვლევის ხანაში ბრუნდება.

"მასშტაბირების" მოუთოკავ მიდგომას, ალბათ, ამ ეტაპზე ყველაზე ნათლად OpenAI-ს სემ ალტმანი წარმოადგენს, რომლის თქმითაც, ამ ეტაპზე ყველაფერი მოთხოვნის ზრდაზე მიანიშნებს და ირწმუნება, რომ კომპიუტერული შესაძლებლობების გაორმაგების შემთხვევაში მის კომპანიას ახლა ორმაგი შემოსავალი ექნებოდა.

ალტმანი მისი თავდაჯერებულობის გასამართლებლად ხშირად იშველიებს ექსპონენციური ზრდის ცნებას და მოგვიწოდებს, რომ აღებულ გეზს "ვენდოთ". "ჩვენ არ ვართ შექმნილნი იმისთვის, რომ ამის წარმოდგენა შევძლოთ, მაგრამ უბრალოდ უნდა ენდო." - იმეორებს OpenAI-ს აღმასრულებელი დირექტორი.

"მასშტაბირების" ტრენდს აკრიტიკებს Meta-ს მთავარი AI მეცნიერი, იან ლეკუნიც, რომელიც მკაფიოდ უსვამს ხაზს, რომ მხოლოდ არსებული ენის მოდელების მასშტაბირება ადამიანის ან დოქტორის ხარიხის დონის ინტელექტს ვერ შექმნის.

"ჩვენ ვერ მივიღებთ ადამიანის დონის AI-ს უბრალოდ LLM-ების მასშტაბირებით. ეს არ მოხდება. აბსოლუტურად შანსი არა. წარმოდგენა, რომ გენიოსების ქვეყანა გვექნება მონაცემთა ცენტრში, სრული ბოდვაა." - ამბობს ლეკუნი.

მისი აზრით, მთელი ამ ინვესტიციების დიდი ნაწილი, რასაც AI ინფრასტრუქტურაში ვხედავთ, "დასკვნების გამოტანის" ეტაპის გაუმჯობესების მიზანს ემსახურება: "წარმოიდგინეთ, რომ წლის ბოლოს ერთი მილიარდი მომხმარებელი გყავს... ამ ადამიანებს დიდი რაოდენობით გამოთვლა ესაჭიროებათ." - აღნიშნავს ის.

თუმცა, ლეკუნი არ ამტკიცებს, რომ ეკონომიკურად გაუმართლებელია მთელი ის ინფრასტრუქტურული პროექტები, რომლებიც ამჟამად დიდი ოდენობის ინვესტიციების დანიშნულების ადგილს წარმოადგენენ. Meta-ს AI მეცნიერის თქმით, ამ ინფრასტრუქტურის გამოყენება მაინც მოხდება და ამატებს, რომ "ამაზე კითხვები თითქმის არ არსებობს."

ლეკუნი განმარტავს, რომ AI კომპანიას ახლა არ შეუძლია, ინფრასტრუქტურაში ინვესტიცია არ ჩადოს, ვინაიდან "თუ ფული გაქვს", რომელსაც AI მომავალში არ დებ, მისი გადმოსახედიდან, ამით "ზედმეტად დიდი რისკს" იღებ.

ამას გარდა, ლეკუნი ხაზგასმით აღნიშნავს, რომ ახლანდელი LLM მოდელები საკმარისად დიდი ოდენობის მონაცემებზე არიან გაწვრთნილნი და შესაძლოა მათთან საუბრისას გაგიჩნდეს განცდა, თითქოს გვერდით დოქტორანტი გიზის, მაგრამ რეალურად ამ AI სისტემებს "უზარმაზარი მეხსიერება და მოძიების უნარი აქვთ." მისი თქმით, ეს არ არის "სისტემა, რომელსაც ახალი პრობლემების გადაჭრა შეუძლია."

იგი ასევე არ უარყოფს, რომ დიდი ენის მოდელებს რეალური სარგებლის მოტანა შეუძლიათ: "არ ვამბობ, რომ თანამედროვე გენერაციული AI სასარგებლო არ არის... კომპანიების უმეტესობას გარკვეული სახის შიდა ექსპერტი ესაჭიროება, რომელმაც ყველა შიდა დოკუმენტი იცის." მისი თქმით, მსგავსი ექსპერტი კომპანია Meta-საც ჰყავს, რომელიც ძალზე გამოსადეგია.

თუმცა, ლეკუნის მიხედვით, იმედის დამყარება იმაზე, რომ მხოლოდ "მასშტაბირებაზე" ფსონის დადებით ადამიანის დონის AI-მდე მისვლა იქნება შესაძლებელი, შესაძლოა, არ იყოს კარგი იდეა.

აქვე უნდა აღინიშნოს, რომ AI ინდუსტრიაში არსებული გამოწვევების მიუხედავად, სფეროს ექსპერტები და მოწინავე ფიგურები მიიჩნევენ, რომ AI ტექნოლოგიის პოტენციალის სრული რეალიზაცია ჯერჯერობით არ ხდება.

მაგალითად, სუცკევერი ამბობს, რომ "ამჟამად მოდელები იმაზე უფრო ძლიერები ჩანან, ვიდრე ამას მათი ეკონომიკური გავლენა გვეუბნება". ამავე აზრზეა ანდრეი კარპატიც:

"არსებული შესაძლებლობებითაც, მიმაჩნია, რომ ინდუსტრია თავისი პოტენციალის რეალიზების 10%-თან ახლოსაც კი არ არის მისული." - განმარტავს კარპატი.

იმიტაციის თამაში

კაცობრიობის მომავალში ხელოვნური ინტელექტის როლის შესახებ ფილოსოფიური კითხვები მრავალი ათწლეულით უსწრებდა დღესდღეობით AI სისტემების გარშემო ატეხილ აჟიოტაჟსა და ჩვენს ცხოვრებაში LLM-ების ყოველდღიური გამოყენების საგნად დამკვიდრებას.

ელექტრონული კომპიუტერების გამოჩენასთან ერთად, ჯერ კიდევ 1950-იან წლებში, დაიწყო მსჯელობა იმაზე, შესაძლებელია თუ არა AI სისტემებში სუბიექტური გამოცდილებისა და ცნობიერების აღმოცენება.

ტიურინგის ტესტი, რომელსაც 1950 წელს თავად ალან ტიურინგმა იმიტაციის თამაში უწოდა, ამ ფილოსოფიურ კითხვებში გზის გაკვალვის ადრეული მცდელობა იყო. ტიურინგმა მეტაფიზიკისგან გვერდის ავლა სცადა და ტესტში ყურადღება მხოლოდ დაკვირვებად შესაძლებლობებზე გაამახვილა, თუმცა, ამის მიუხედავად, ფილოსოფიის უკან ჩამოტოვება ვერ მოხდა, ვინაიდან მანქანებისა და ხელოვნური ინტელექტისგან დამოუკიდებლად მუდამ არსებობდა რეალური ეპისტემური ზღვარი, რომელიც "სხვათა გონებების პრობლემით" არის ცნობილი.

პრობლემის არსი მდგომარეობს იმაში, რომ ადამიანს, ერთ სუბიექტს, არ შეუძლია დანამდვილებით დაადასტუროს სხვა სუბიექტის ცნობიერება და თვითაღქმა. ამ დასკვნამდე მისვლა მხოლოდ ქცევით, ენით ან საერთო ბიოლოგიურ პატერნებით არაპირდაპირ შეიძლება. ტიურინგისთვის ცხადი იყო, რომ სუბიექტურ გამოცდილებაზე პირდაპირი დაკვირვება შეუძლებელი იქნებოდა, რის გამოც იგი მანქანებში ინტელექტის არსებობაზე ამ გზით პასუხის მიღებაში ამაოებას ხედავდა.

ცნობიერების საკითხის გადაჭრის ნაცვლად ტიურინგმა კითხვას თავი აარიდა და შექმნა ლინგვისტიკური და ბიჰევიორისტული კრიტერიუმი, რომელმაც, საბოლოოდ, უძველეს კითხვებზე პასუხების ნაცვლად ფილოსოფიაში უფრო მეტი ახალი კითხვა გააჩინა.

სუბიექტური ონტოლოგიური გამოცდილებიდან ყურადღების დაკვირვებად შესაძლებლობებზე გადმოტანით, ტიურინგს სურდა, "ინტელექტი" დაკვირვებადი გამხდარიყო, მაგრამ მან ამით დაასუსტა ის, თუ რას ნიშნავს ზოგადად ინტელექტი - იმიტაციას თუ გააზრებას? სიმულაციას თუ რეალობას?

ამ მხრივ ჯონ სერლი ამბობს, რომ შესაძლოა, სისტემა ზედმიწევნით კარგად, უნაკლოდ, დაეუფლოს იმიტაციის თამაშს, გაიაროს ყველა ბიჰევიორისტული ტესტი და საბოლოოდ მაინც არაფერი არ ესმოდეს, არაფერი ჰქონდეს რეალურად გააზრებული. სწორედ ეს არის "ჩინური ოთახის" მთავარი გაკვეთილი.

"ჩინური ოთახის არგუმენტი აჩვენებს, რომ აგენტს შესაძლოა, თქვენთვის სასურველი ნებისმიერი ფორმალური პროგრამა ჰქონდეს და ჩინურის გაგების ტიურინგის ტესტსაც გადიოდეს და მაინც ერთი სიტყვა ჩინურიც არ ესმოდეს. და ამის მიზეზი ის არის, რომ ჩინურ ოთახში მყოფ პირს აქვს სინტაქსი და არა - სემანტიკა, ე.ი. მას აქვს ჩინური სიმბოლოები და წესები მათი მანიპულირებისთვის, მაგრამ არ გააჩნია ამ ჩინური სიმბოლოებისთვის მნიშვნელობის მიკუთვნების არანაირი გზა". - წერდა ის.

სერლი იმასაც აღიარებდა, რომ შესაძლებელია, ორ სისტემას შორის გარეგნულად არანაირი განსხვავება არ არსებობდეს, მაგრამ ისინი შინაგანად განსხვავებული პრინციპების მიხედვით მოქმედებდნენ. ამისთვის, სერლს ორთქლისა და ელექტრულ ლოკომოტივებს შორის შედარება მოჰყავს არგუმენტად.

"მექანიკურ რობოტს, რომელიც ლუდის თუნუქის ქილებზეა აწყობილი, პრინციპში, შეუძლია ადამიანის საქციელის ზუსტი სიმულირება და მაინც არ ჰქონდეს არანაირი ფსიქიკური მდგომარეობა. ეს არ არის იმაზე მეტად მისტიკური, ვიდრე ის ფაქტი, რომ როგორც ორთქლის, ისევე ელექტრულ ლოკომოტივს მატარებლის გაწევა ერთი სიჩქარით შეუძლიათ ერთსა და იმავე მანძილზე, მიუხედავად იმისა, რომ ისინი საკმაოდ განსხვავებული შინაგანი პრინციპებით მუშაობენ. ზოგადად, ორ სისტემას შეუძლია ერთნაირი გარეგნული ეფექტის გამომუშავება, საკმაოდ განსხვავებულ შიდა პრინციპებზე მუშაობასთან ერთად." - განმარტავდა სერლი.

ამის გათვითცნობიერებას, თავის მხრივ, მთელ რიგ ცალკეულ კითხვებთან მივყავართ, რომლებთანაც თვალის გასწორება და მათზე პასუხების ძიება კაცობრიობას გარდაუვლად მოუწევს, ახლო თუ შორეულ მომავალში. კითხვების სერიოზულად დასმის პროცესი კი უკვე დაწყებულია.

"რეალურად შეუძლებელია იცოდე, უბრალოდ ფიქრობს ამას [AI] თუ უბრალოდ ეს ბევრჯერ ნახა გაწვრთნის ეტაპზე. და, რა თქმა უნდა, თუკი განსხვავებას ვერ ხედავ, რამდენად გადარდებს ეს?" - თქვა OpenAI-ს სემ ალტმანმა TED2025-ის კონფერენციაზე, რომელიც AI-ს მომავალს ეხებოდა.

"რამდენად გვადარდებს ეს?" - არის კითხვა, რომელსაც ერთხელ მოსმენის შემდეგ მრავალჯერ მიუბრუნდები და, ამავროულად, AI სისტემების განვითარებასთან ერთად, უფრო და უფრო ხშირად ჩავძახებთ ერთმანეთს. ამ კითხვას დიდი მნიშვნელობა აქვს, რადგან მასზე ნებისმიერ პასუხს პეპლის ეფექტის გავლენა ექნება კაცობრიობის განვითარების მიმართულებაზე.

AI სისტემების განვითარებასთან ერთად მოხდება მათ მიმართ ადამიანების დამოკიდებულებების უნებური გარდასახვაც, ერთი ან მეორე მიმართულებით. ამის გამომწვევი სხვადასხვა ფაქტორი იქნება, მათ შორის, ფუნდამენტური ცვლილებები ეკონომიკაში, სამუშაო გარემოს გარდაქმნა, AI-ს გავლენა განათლებაზე, ადამიანების ურთიერთობასა და ზოგადად ჩვენს ცხოვრებაზე.

უფრო და უფრო დამკვიდრდება LLM-ების გამოყენება, AI დამხმარეები, მაგრამ მათი სახით ასევე მივიღებთ სამუშაოს ჩამნაცვლებლებსაც, შესაძლოა, სამომავლოდ AI მენეჯერებსაც. ამ ტექნოლოგიის გამოყენება მოხდება კეთილი მიზნებისთვის, მეცნიერებისთვის, საზოგადოებრივი პრობლემების აღმოსაფხვრელად, მაგრამ ამავდროულად AI სისტემებზე წვდომა ექნებათ ბოროტ აქტორებსაც, რომლებიც AI-ს ინდივიდების ან ზოგადად კაცობრიობის წინააღმდეგ გამოიყენებენ. საინტერესოა ისიც, რომ AI-ს სწრაფი და ყოვლისმომცველი გამოჩენით გამოწვეული "დაღლილობის" ფონზე უკვე გამოჩნდნენ ადამიანები, რომლებიც "AI ვეგანიზმის" პრაქტიკა დაიწყეს.

შედარებით ფუნდამენტურ დონეზე კი პოლარიზაცია მოჰყვება AI-ს მზარდ ანთროპომორფიზაციასაც: ზოგი ამ ტრენდს მიესალმება, ზოგიც წინააღმდეგობის გაწევას შეეცდება. არ არის გამორიცხული, რომ საკითხმა მკვეთრად პოლიტიკური განზომილებასაც შეიძინოს და, სხვა ანალოგიური ხასიათის საკამათო თემების მსგავსად, AI სისტემებსაც გაუჩნდეს უფლებადამცველები ან ამ იდეის მოწინააღმდეგეები.

თუმცა, არსებობს იმის შანსიც, რომ ორივე მხარეს მარტივი სიმართლე დაავიწყდეს - რომ ეს სისტემები ჩვეულებრივ ტექნოლოგიას წარმოადგენენ, რომელიც იმიტაციის თამაშშია ჩართული. ამ მხრივ კი ირონიაა ის, რომ რაც უფრო მეტად ვწვრთნით AI-ს ადამიანის ენაზე და რაც უფრო ვცდილობთ მათგან ადამიანის ხატის შექმნას, უფრო მეტად ვუწყობთ AI სისტემებს ხელს, რომ იმიტაციის თამაშში ადამიანის მოტყუებაში უფრო მეტად დახელოვდნენ.

(Brooklyn Museum Archives)

უდავოა მხოლოდ ის, რომ AI რევოლუცია უეცრად დაგვატყდა თავს. განწყობა მე-19 საუკუნის ბოლოს გაზის ნათურებით განათებულ პარიზის ქუჩებში გასეირნებას ჰგავს მაშინ, როცა იცი, რომ შენ თვალწინ არსებულ სურათს ვეღარასდროს იხილავ მომდევნო საუკუნეში, როცა ქალაქში უკვე ელექტრონული ნათურების სინათლე იქნება მოფენილი. გლობალური პანდემიის შემდეგ კაცობრიობა მოულოდნელად მგზავრის სავარძელში დაბმული აღმოჩნდა, მანქანა კი დიდი სისწრაფით პასუხგაუცემელი კითხვებისკენ მიემართება. გასარკვევი მხოლოდ ისაა, როდის მივალთ დანიშნულების ადგილამდე და როგორი მსოფლიო დაგვხვდება იქ.